人間中心のAI(HCAI)とは?政府が提唱する「7つの社会原則」についてもわかりやすく解説!

INDEX

AI技術は、現在日常生活からビジネスまで幅広い分野で浸透しており、欠かせない存在の1つになっています。

そんなAIは、現在も進化を続けており今後は人間を超えていく性能を持ったAIも誕生すると言われています。

そのため、世界的にAI活用に対してさまざまな対策や考え方を考案してリスクを抑えようと進めています。

今回は、そんなリスク対策の中でも「人間中心のAI(HCAI)」や政府が提唱する「7つの社会原則」についてわかりやすく解説します。

AIとは?

AIとは、「 Artificial Intelligence」という言葉の略称で、人工的に開発された知能のことです。

現在では、さまざまな分野でAI技術が活用されており、AIがなければ日常生活を快適に送ることが難しくなってしまうほど浸透しています。

そんなAIは、AIが与えられたデータを学習して最適な答えを導き出すという機械学習の仕組みによって機能しています。

さらに、機械学習を行うほどAIの学習精度は向上し、より高精度になっていくという特徴があります。

そのため、将来的にはAIが人間を超えていく可能性が十分に考えられています。

人間中心のAI(HCAI)とは?

人間中心のAI(HCAI)とは、「Human-Centered AI」という言葉の略称で、「AIが人間を管理するのではなく人間がAIを管理する」という考え方を元にAI活用をすることです。

AIを人間が徹底して管理することによって、AIに起きうるさまざまなデメリットやリスクを最小限に抑えて効果的に活用することができます。

そのため、現在では日本政府やMicrosoftなどの大手IT企業なども、この人間中心のAI(HCAI)に注目しています。

人間中心のAI(HCAI)が注目されている理由

人間中心のAIが注目されている背景には、主に以下のような理由があります。

- AI活用にリスクがあるから

- AIには不確実性を伴うリスクがあるから

ここでは、人間中心のAIが注目されている理由について解説します。

AI活用にリスクがあるから

AIを活用することで、さまざまなメリットを得ることができますが、反対にデメリットも多く存在しています。

AI技術の進歩によって多くの分野で人間が行っていた作業をAIが代替するようになってきているので、人材不足解消や業務効率化などが進んでいます。

しかし、さらにAIの代替が進んでいけば、人材不足に陥っていない業界でも業務のほとんどがAIに代替されていき、仕事を失う方が続出してしまうリスクがあります。

AIには、以上のようなリスクも潜んでいることから、人間中心のAI(HCAI)の考え方が注目されるようになりました。

AIには不確実性を伴うリスクがあるから

AIには、不確実性を伴うリスクがあります。

主に、人間の仕事を奪ってしまったり、AI自身が人間を管理するようになるといった確実に起きることではないけど、リスクのあることが多いです。

人間がAIに管理されるようになってしまうと、AI活用によって得られた快適な生活とは反対に生きにくい社会が実現してしまうリスクが高くなります。

そのため、以上のようなAIの不確実性を伴うリスクを懸念した結果、人間中心のAI(HCAI)が注目されています。

政府が提唱する「7つの社会原則」とは?

政府が提唱する「7つの社会原則」とは、以下の通りです。

・AIは人間の基本的人権を侵さない

・誰もがAIを利用できるよう教育を充実

・個人情報を慎重管理

・AIセキュリティーの確保

・公正な競争環境の維持

・AIを利用した企業に決定過程の説明責任

・国境を越えてデータを利用できる環境を整備

現在の日本では、この「7つの社会原則」を元にAIの法整備やAI活用に対するルールなどの設定を進めている状況です。

責任あるAIとは?

責任あるAIとは、AIが抱えている問題の解決を進めるために、AI研究・開発を行う企業やそのAIのユーザーが責任を持って取り組む指針のことです。

AIには、さまざまなリスクがあるので、AIが意図せずに人種差別や犯罪の助長をしてしまう可能性などがあります。

さらに、AI活用によって大量リストラや情報漏洩、権利問題なども発生してしまうリスクが高いです。

そのため、AIを扱うユーザーとAIを開発する企業は、それらのリスクやデメリットに対してしっかりと責任をもって取り組む必要があります。

責任あるAIが注目されている理由

AIには、発生したトラブルに対して責任を負うことができないという問題があります。

そのため、「AIによって起きた問題の責任は誰が負うのか?」となった場合に、AIの開発会社やAIを利用したユーザーなどになります。

しかし、AIの開発会社にも原因が突き止められない状態やAIユーザーが十分に情報を理解していない場合は判断が難しいです。

そこでしっかりと社会全体で「誰にどんな責任があるのか」を明確にすることが求められるようになったことで、責任あるAIが注目されるようになりました。

AIのメリット

AIを導入することで、さまざまなメリットを得ることができます。

そんなAIの具体的なメリットには何があるのか気になる方も多くいます。

ここでは、AIのメリットについて解説します。

コスト削減

AIを導入することで、コスト削減になります。

AIは、これまで人間が行っていた作業を自動化させて業務効率化を推進することができたり、データを効果的に活用して売上予測やコスト削減のための施策立案などが可能です。

さらに、人件費を削減することができるので、利益率の向上や労働時間の削減などにも効果的です。

そのため、リソースを確保することもできます。

人材不足の解消

AIは、人材不足の解消にもなります。

現在、日本の多くの業界では深刻な人材不足によって廃業する企業や通常業務が進められない企業が増加しています。

AIを導入することによって、これまで人材不足によって業務ができなかった企業でも、業務を自動化して最小限の人材のみで経営を続けることが可能です。

さらに、人材不足を解消することは、日本社会全体にとってとても大きなメリットになります。

データ活用の最適化

AIは、人間では扱うことの困難であるビッグデータなどを扱い、効果的に活用することが可能です。

AIが膨大なデータを活用して、顧客データや市場データを分析することで、これまでよりも効果的なマーケティング施策を行うことができます。

また、これまで意識していなかった角度での分析や情報収集も可能です。

さらに、事故やトラブルの発生確率や防止するための方法なども効果的に立案することができるので、より安全で便利な社会を目指すことが可能です。

ヒューマンエラーの削減

AIを導入することで、これまで人間が行っていた作業がほとんど自動化されます。

その結果、人間の不注意などによるヒューマンエラーを大幅に削減して安全でミスの少ない業務を実現させられます。

さらに、ヒューマンエラーの削減によって、従業員や顧客の安全を維持した作業が行えたり、同じ時間あたりの生産性も大幅に向上させることが可能です。

特に、工場などの危険が多く潜んでいる職場では、AI活用がとても重要視されています。

AIのデメリット

AIを導入することで得られるメリットは多くありますが、反対にデメリットもあります。

これからAI活用を進めていく場合は、しっかりとデメリットも理解しておくことが大切です。

ここでは、AIのデメリットについて解説します。

コストがかかる

AIを導入することで、コスト削減ができるというメリットがありますが、AI導入には高いコストが必要です。

主に、AIを開発するための費用や人材、知識、AI人材を採用するための人件費や採用活動などがあります。

以上のようなコストをしっかりと支払うことができる企業であれば問題ありませんが、多くの中小企業にとって簡単なことではありません。

そのため、AI導入を検討する場合は、しっかりとコスト面を考慮することが大切です。

ブラックボックス化

AIには、ブラックボックス化という大きなデメリットがあります。

ブラックボックス化とは、AIが算出した結果がどのような思考プロセスによって算出されたものなのかわからないことです。

この思考プロセスがわからない状態では、AI活用によって起きた問題の分析や改善などができないので、効果的にAIを活用することが困難になります。

そのため、AIを今後多くの分野で活用していくためには、ブラックボックス化を解消させていくことが大切です。

責任問題がある

AIは、AI自身が責任を取ることができないので、AI活用の際には責任問題が発生します。

例えば、AIを搭載したロボットが誤作動を起こして従業員に損害を与えてしまった場合に、その責任は誰が取るのか明確化させることが難しいです。

AIを提供している企業に取らせる場合でも、そのAIが原因不明で誤作動を起こしていれば簡単に企業の責任にすることができません。

そのため、このAIの責任問題も今後解決させていかなければいけない課題の1つです。

情報漏洩のリスク

AIには、情報漏洩などのセキュリティリスクがあります。

AIは、基本的にビッグデータを活用して学習を進めていき高度な性能を発揮しますが、その学習の家庭でデータが流出してしまうリスクがあります。

そのため、AIを活用する場合は、AI管理者やデータサイエンティストなどのAI人材たちが徹底してAI運用を行うことが大切です。

万が一、AIによって情報漏洩が起きてしまうと、大きな損失になる可能性もあります。

まとめ

AIは、今後もさらに進化を続けており、さまざまな分野での活用が進んでいくことが予想されています。

そのため、AIがいつか人間を超えていき、人間が管理されてしまうリスクなどもあります。

また、AI活用には現状として、さまざまなデメリットが存在しているので、人間中心のAI(HCAI)の考え方は、とても重要になっていきます。

これからAI活用を進めていく方は、ぜひ人間中心のAI(HCAI)についての理解を深めていくことをおすすめします。

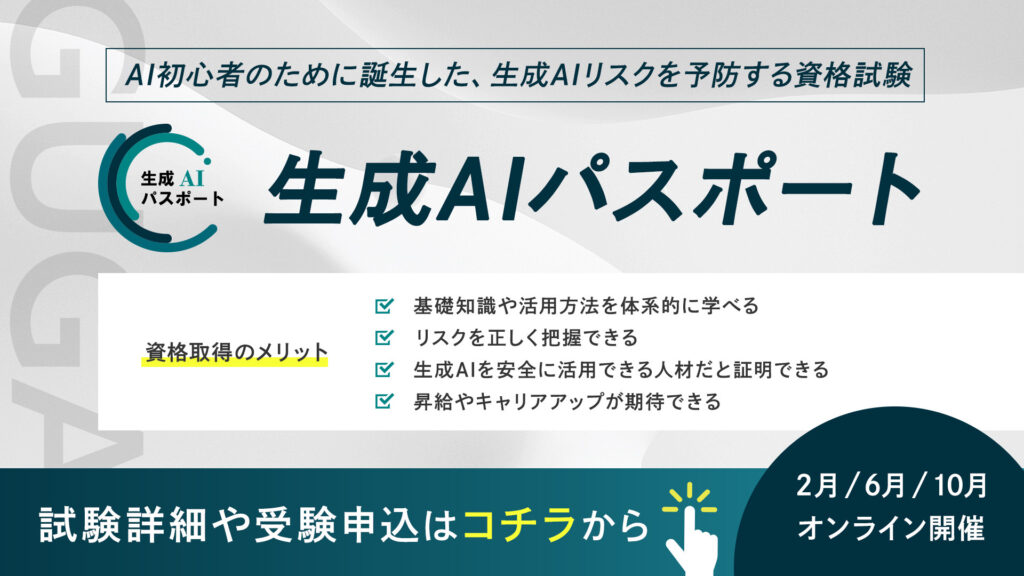

さらに、今注目を集める生成AIリスキリングの第一歩を。生成AIパスポートとは?

生成AIパスポートは、一般社団法人生成AI活用普及協会(GUGA)が提供する、AI初心者のために誕生した、生成AIリスクを予防する資格試験です。AIを活用したコンテンツ生成の具体的な方法や事例に加え、企業のコンプライアンスに関わる個人情報保護、著作権侵害、商用利用可否といった注意点などを学ぶことができます。

⽣成AIの台頭により、AIはエンジニアやデータサイエンティストといった技術職の方々だけではなく誰もがAIを使えるようになりました。今、私たちがインターネットを当たり前に活用していることと同様に、誰もが生成AIを当たり前に活用する未来が訪れるでしょう。

そのような社会では、採用や取引の場面で、生成AIを安全に活用できる企業・人材であることが選ばれる前提条件になり「生成AIレベルの証明」が求められることが予測できます。生成AIパスポート試験に合格すると、合格証書が発行されるため、自身が生成AIを安全に活用するためのリテラシーを有する人材であることを、客観的な評価として可視化することが可能です。

ぜひあなたも生成AIレベルを証明し「生成AI人材」に仲間入りしましょう!