AIのハルシネーションとは?意味や基礎知識、原因やその対策まで事例を交えてわかりやすく解説

INDEX

現在、AIはさまざまな分野で活用が進んでおり、完全にAIに依存してしまっているケースも少なくありません。

ただ、AIは完璧な技術ではないので、時には誤った動作をしてしまう可能性があります。

そんなAIの誤った現象の1つとして「ハルシネーション」があります。

今回は、AIのハルシネーションの意味や基礎知識、原因やその対策まで事例を交えてわかりやすく解説します。

ハルシネーションとは?

ハルシネーションとは、AIが事実に基づかないもっともらしい嘘を生成してしまう現象のことです。

ハルシネーションとは、「幻覚」を意味する言葉から付けられた名前であり、人間が幻覚を見ているような結果をAIが出力してしまうことからそう呼ばれています。

特に、このハルシネーションは、画像生成やテキスト生成などで起きやすい現象です。

そのため、AIで画像生成やテキスト生成を行う場合は、ハルシネーションが起きないように注意が必要になります。

AIとは?

AIとは、「 Artificial Intelligence」という言葉の略称で、人工的に開発された人間と同じ思考ができる知能のことです。

主に、過去のデータをAIに与えて学習させる機械学習によって、AIはデータを自動的に学習していき、画像生成やテキスト生成、音声翻訳などの精度を向上させます。

現在では、スマートフォンやPC、タブレットなどのデバイスから自動車や電化製品にまで幅広く搭載されている技術です。

AIの仕組み

AIは、データを大量に与えてそのデータの傾向やパターンを学習させる機械学習という仕組みによって動作しています。

例えば、画像認識をAIに行わせる場合は画像データをAIに大量に与えることで、AIがその画像データを分析して、画像に写っている者を認識することが可能です。

さらに、この機械学習という仕組みは、より多くのデータをAIに与えて学習させていくことで、精度が向上します。

そのため、AIは活用されるほど精度が向上し、画像認識であればより正確に画像に映る物を認識することが可能です。

機械学習とディープラーニングについて

AIの仕組みを理解する上で欠かせないのが機械学習とディープラーニングです。

ここでは、AIには欠かせない機械学習とディープラーニングについて解説します。

機械学習

機械学習とは、上記でも解説した通りAIにデータを与えてそのデータの傾向やパターンを自動的に学習させていく技術のことです。

また、機械学習には、主に以下3つの手法があります。

- 教師あり学習:ラベル付きデータ(正解データ)を与えて学習させる

- 教師なし学習:ラベルが付いてないデータを与えて学習させる

- 強化学習:結果を最大化させるためにAIに試行錯誤させながら学習させる

ディープラーニング

ディープラーニングとは、機械学習の手法の1つであり、上記で解説した手法よりも柔軟な判断を導き出すことができる手法でもあります。

機械学習では、ニューラルネットワークというアルゴリズムが存在します。

ニューラルネットワークは、最初にデータを受け取る「入力層」・入力層から情報を引き継ぎデータ処理を行う「中間層」・処理されたデータを出力する「出力層」の3層から構成されています。

そしてディープラーニングでは、このニューラルネットワークの中間層が多層化した構造になっているので、より複雑で大量なデータを学習して結果を導き出すことが可能です。

そのため、ディープラーニングは自動認識や自動運転、医療などさまざまな分野で活用が進んでいます。

ハルシネーションの原因

AIは完璧な技術ではないので、ハルシネーションといった現象が起きてしまうケースがあります。

そんなハルシネーションの原因を突き止めることができれば、ハルシネーションを減らすことが可能です。

ここでは、ハルシネーションの原因について解説します。

誤った学習データを与える

AIは、インターネット上に存在する膨大なデータから学習します。

そのため、最初に与えるデータの質によってその後のAIの精度は大きく左右されてしまいます。

最初に与えた学習データが誤っている場合は、AIがその誤ったデータを学習してしまうので、ハルシネーションが発生してしまいます。

誤ったデータから学習して導き出された結果は当然誤った結果なので、十分に注意が必要です。

与えるデータが古い

AIは、最初に大量にデータを与えて機械学習をさせることで、精度の高い結果を導き出せます。

ただ、ここで与えるデータが古い場合は最新のデータに対してAIの学習データが含まれていないので、ハルシネーションが発生します。

特に、現代では時代と共に大きく情報が更新されているので、AIに古い情報を与えてしまうと大きなずれが生じる確率が高いです。

そのため、AIに与えるデータの鮮度も充実することが大切です。

データを推測する

AIに、AIがわからないような質問をすると、AIが学習データから無理やり推察して結果を出すことがあります。

ここで、AIが推察して導き出した結果はあくまでも推察の域を出ないので、正確な情報とは限らず誤っていることがほとんどです。

さらに、テキストだけではそのデータがAIによる推察なのか判断することが難しいので、注意が必要です。

特に、ChatGPTなどの自動応答AIなどで発生しやすい原因なので、利用している方は意識しておきましょう。

ハルシネーションの事例

AIのハルシネーションが発生する原因にどのようなものがあるのかわかりましたが、具体的にどのような事例があるのか気になります。

これからAIを活用する方は、ハルシネーションの事例を踏まえた上でAIが誤りを起こしていないか判断してみてください。

ここでは、ハルシネーションの事例について解説します。

架空のことを質問する

AIのハルシネーションは、データを推測することで発生することが多いです。

CHatGPTでは、日々多くのユーザーからの質問に対して回答をしており、その中には架空のコンテンツや人物に対する質問などにも対応しています。

例えば、「架空のアニメA」についてChatGPTに質問した際には、ChatGPTは「存在しない」と回答せず、しっかりとあらすじやジャンルなどを回答してくれます。

そのため、この時点でAIによるハルシネーションが発生していることになり、ChatGPTが出した回答は完全に誤りのデータであることが判断できます。

ChatGPTの回答

ChatGPTは、架空の質問に推察で回答してしまう事例以外にも、さまざまなハルシネーションを発生させています。

特に、ChatGPTは2021年9月までのデータまでしか学習されていなかったので、それ以降のデータに関してはデータを保有していない状態です。

そのため、ハルシネーションが発生する原因がすでに存在しています。

他にも、「日本で2番目に大きい湖は何?」という質問に対して日本最大の湖である「琵琶湖」と回答してしまうなどの誤った回答をしてしまうケースが多いです。

そのため、CHatGPTのユーザーは、ハルシネーションを意識して利用することをおすすめします。

ハルシネーションの対策方法

ハルシネーションが起きないように対策することは重要ですが、完全に防ぐことはほぼ不可能です。

ただ、ハルシネーションが起きた場合でもしっかり対応できるように対策しておくことができます。

ここでは、ハルシネーションの対策方法について解説します。

ハルシネーションが起きることを考慮しておく

AIを活用していく上で、ハルシネーションが起きることを考慮しておくことで、ハルシネーションの対策が可能です。

事前にハルシネーションが起こることを考慮しておけば、ハルシネーションが起きた場合でも誤ったデータに影響されるリスクを減少させられます。

さらに、「AIが出力した結果は全て正しい」というリスクの高い考え方を払拭することができるので、「AIはあくまでも参考データ」という柔軟な考え方になります。

そのため、これからAIを活用する場合は、しっかりとハルシネーションが起こることを念頭に置いておきましょう。

AIの扱いを定めておく

AIを企業や組織で活用する場合、しっかりとAIの扱いについてガイドラインやマニュアルなどで定めておくことが大切です。

しっかりとAIを活用するメリットやリスク、ハルシネーションなどについて組織全体に周知できていれば、ハルシネーションによる問題は起きにくくなります。

さらに、組織全体にAIに対する理解が深まり、より効果的に扱えるようになるので、とても効果的な対策方法の1つです。

回答結果をしっかりと確認する

ChatGPTなどのAIを使って解凍されたデータをしっかり確認することも効果的な対策方法になります。

AIが出力した結果を全て正しいと判断するのではなく、公的機関や公式サイト、ニュースサイトや論文サイトなどの有力なソース元と参照するのが重要です。

基本的に以上のような一次情報を発信しているサイトは、AIが出力した結果よりも信用できます。

そのため、回答結果にハルシネーションの疑いがある場合は、しっかりと確認するようにしましょう。

Birdを活用する

Birdとは、Googleが提供しているAIツールのことです。

主に、画像生成やコード生成、Googleアプリとの連携などが行える優れたAIツールであり、誰でも無料で利用できます。

そんなBirdには、「ダブルチェック」というAIによって生成されたデータを検知する機能が搭載されています。

ChatGPTなどのAIツールで出力された結果が正しいデータであるかどうか気軽に確認することが可能です。

そのため、ハルシネーション対策を検討している場合は、Birdを活用してみることをおすすめします。

まとめ

ハルシネーションは、AIを活用していく上で重要視しなければいけない現象の1つです。

ハルシネーションに気付かずにそのままAIを活用してしまえば、ハルシネーションによる被害を受けてしまうリスクが高くなります。

しかし、しっかりと原因を理解し対策を行っていれば、効果的にAIを活用することが可能です。

これからAIを活用していく際は、しっかりとハルシネーションについて理解しておくことをおすすめします。

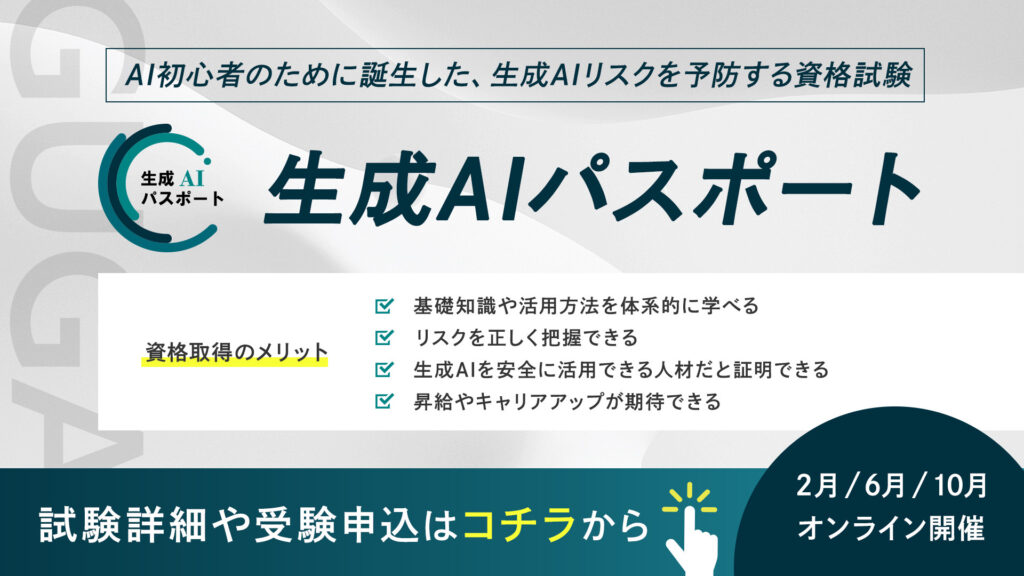

さらに、今注目を集める生成AIリスキリングの第一歩を。生成AIパスポートとは?

生成AIパスポートは、一般社団法人生成AI活用普及協会(GUGA)が提供する、AI初心者のために誕生した、生成AIリスクを予防する資格試験です。AIを活用したコンテンツ生成の具体的な方法や事例に加え、企業のコンプライアンスに関わる個人情報保護、著作権侵害、商用利用可否といった注意点などを学ぶことができます。

⽣成AIの台頭により、AIはエンジニアやデータサイエンティストといった技術職の方々だけではなく誰もがAIを使えるようになりました。今、私たちがインターネットを当たり前に活用していることと同様に、誰もが生成AIを当たり前に活用する未来が訪れるでしょう。

そのような社会では、採用や取引の場面で、生成AIを安全に活用できる企業・人材であることが選ばれる前提条件になり「生成AIレベルの証明」が求められることが予測できます。生成AIパスポート試験に合格すると、合格証書が発行されるため、自身が生成AIを安全に活用するためのリテラシーを有する人材であることを、客観的な評価として可視化することが可能です。

ぜひあなたも生成AIレベルを証明し「生成AI人材」に仲間入りしましょう!