ファインチューニングとは?意味やメリット・デメリット、転移学習との違いについてわかりやすく解説

INDEX

皆さんはファインチューニングをご存じですか?ファインチューニングはゼロから開発を行わなくても新しいものを構築できるのが特徴的な学習手法です。よりモデルを強化していく場合などに使えます。

本記事ではファインチューニングとは何かを中心に、ファインチューニングの意味やメリット・デメリットなどをご紹介していきます。

ファインチューニングとは?

ファインチューニングとはどういうものなのか、その意味や基本的な情報をご紹介していきます。

ファインチューニングの意味

ファインチューニングは「finetune」という単語から来ています。「finetune」には安定させるという意味もあれば、微調整するという意味もあります。これが転じる形でファインチューニングは、新しい層を設ける形で微調整を行い、よりよいモデルにしていくという意味があるのです。

ファインチューニングの概要

ファインチューニングは、既存の学習モデルに対して、データを追加する、新しい層を設けるなどして調整を行った上で再び学習を行っていく手法を指します。

特化させるために必要なファインチューニング

既存の学習モデルはどちらかといえば汎用性が高めなので、何かに特化しているとは言い難い状態にあります。特定のジャンルで応用したいなど、特定の方向性に特化させていくためにファインチューニングを行っていく狙いがあります。

一定の方向性に特化させるために、専用のデータを追加させてファインチューニングを行うことで様々な色をつけていくことが可能です。

既存の学習モデルは既にハイスペック

ファインチューニングで用いられる既存の学習モデルはビッグデータなど大量のデータによって学習されているものです。いわばハイスペックな状態にあります。

そのため、ファインチューニングで追加されるデータはそこまで多いデータではありません。ちょっとしたデータを追加して方向性を定めた上で学習を行うことでより特化したモデルに仕立てていくことが可能です。

ファインチューニングのメリット

ここからはファインチューニングを行っていくメリットについてご紹介していきます。

コストやリソースを節約できる

ファインチューニングでは既に学習されているモデルを活用して応用していきます。いわばゼロスタートではなく、大部分構築されているものをアレンジするような形になるため、コストやリソースをある程度節約できるのが大きな特徴です。

ゼロから構築していくとなると、色々なコストがかかるほか、計算資源なども必要となります。しかし、ファインチューニングであれば元々あるものをアレンジするだけで済むため、コストをかけずによりよいものに作っていくことが可能です。

わかりやすく例えると、本来であればハイスペックなコンピューターを用意しなければいけないところ、誰でも手に入れられるノートパソコンレベルのものでも十分精度の高いものを作り出せるのです。

モデルを作っていく費用も、場合によっては億単位になってしまうことがあります。ファインチューニングであればゼロから作る必要がなくなるため、億単位も必要なくなるなど、ファインチューニングを応用することで開発コストを下げられるのが魅力的です。

応用がしやすい

先ほどもご紹介した通り、ファインチューニングで用意すべきものは一定量の追加データぐらいで、ベースとなるのはビッグデータなどで既に学習しているモデルです。一定の方向性に特化させたモデルに仕立てていくために、ビッグデータとは言えない追加データを確保していれば応用は可能です。

その点においてファインチューニングは応用がしやすいほか、データ化がしにくいような場合においてもわずかなデータで1つの方向性に特化させながらAIを作り上げていくことが可能になります。

性能を高められる

学習済みのモデルを分かりやすく人間に例えると、スペックの高い人間で、色んな長所を兼ねそろえた頼りになる存在です。しかし、突出した長所がなく、何でも器用にこなせるけれどあと1つ足りないという状態にあります。ここに突出した長所が加われば最強の存在となるでしょう。

ファインチューニングは突出した長所を加えることで、モデルの性能を高めることができます。性能を高めるためにファインチューニングを行うほか、学習済みモデルのブラッシュアップにもつながるでしょう。

ファインチューニングのデメリット

ここからはファインチューニングのデメリットについてご紹介していきます。

過剰に反応してしまうことがある

ファインチューニングがうまくいくケースは追加するデータと学習済みモデルの相性が良い場合です。しかし、万が一追加データとの相性が悪かった場合には、学習済みモデルが過剰な反応を示す場合があります。

いわゆる過学習の問題であり、学習済みモデルが過剰な反応を示すことで質の低い状態に陥ってしまいます。そのため、過学習をいかに起こさせないか、常に過学習の兆しを見極めながら、対処することが求められます。

ハイパーパラメータの存在

ファインチューニングにおいてとても重要なのがハイパーパラメータの存在です。ハイパーパラメータとはそれぞれのモデルにおける学習のやり方などをコントロールしているもので、うまく管理を行うことで効率よく学習したり、モデルのスペックをベストな状態で維持できます。

ハイパーパラメータをチョイスするには、様々な方法を活用してベストな選択をする必要がありますが、実は細かな作業が要求されます。ベストな調整が行えればそれだけ効果を発揮できる一方、ベストを出せないとその効果はかなり落ちてしまうのです。そのため、ハイパーパラメータの選択に関して細心の注意を払う必要があります。

ファインチューニングを行う意味とは

ファインチューニングを行う意味として、特定の技術の能力をアップさせるのに有効な手段として期待されているためです。その1つが大規模言語モデル、LLMです。大規模言語モデルは最初の段階で大量のテキストなどを活用して学習を行わせるため、そのスペックの高さは相当なものです。

このため、どんな業界にも分野にも対応できるようになっているのがLLMの特徴です。このスペックを最大限に引き出すためにファインチューニングが存在します。

ChatGPTもファインチューニングの1つ

一般的にも浸透し始め、期待の技術として注目を集めているChatGPTですが、実はファインチューニングによって生まれたものです。元々ChatGPTはGPTと呼ばれるモデルがベースとなっています。

このGPTに対してユーザーからの質問に答えて回答していくような形でファインチューニングを行っていき、よりよい答えが出せるようにしていく中でChatGPTが誕生しています。

ファインチューニングと転移学習との違い

ここからはファインチューニングと転移学習との違いについて解説していきます。

そもそも転移学習とは何か

転移学習はいわゆる機械学習の学習方法の1つであり、別のところで学習されている知識を、別のところに移し替えて応用するやり方です。

移し替える際には途中までの学習済みモデルを残しておいてから移し替えて、新たなデータで学習を行っていきます。途中までの学習済みモデルを応用する形で新たなデータの学習を行うので、大量のデータを必要としないで質の高い出力が可能になります。

そのため、効率のいい学習だけでなく、応用しやすい点も転移学習の特徴であるため、ファインチューニングとに通っている部分と言えます。

ファインチューニングと転移学習の違い

実際のところ、ファインチューニングと転移学習は似たようなものと言えます。それは途中までのプロセスが共通しているからです。例えば、ファインチューニングと転移学習は新しい層を追加するプロセスがあり、これに関しては共通していると言えるでしょう。

決定的な違いは、微調整の範囲です。例えば、転移学習の場合、新しい層を追加して行う際に、最後の部分だけの調整を行って学習します。そのため、大部分はいじる必要がありません。例えば、車かそうでないかの認識を行ったモデルであれば、車かそうでないかの出力に関する部分だけを変えて、車かそうでないかの認識に至るまでの学習済みモデルは変えないのが転移学習です。

これによって、自転車かそうでないかの学習をさせたい場合に、自転車かそうでないかの出力部分だけを変えればすぐに応用することができます。

その点、ファインチューニングは既存のモデルの一部も一緒に微調整を行っていき、特定の方向性に特化したモデルに仕立てていくことができます。「微調整」という言葉が似合うのは実は転移学習の方かもしれません。

まとめ

ファインチューニングに関しては、ChatGPTを開発したOpenAIが、大規模言語モデルである「GPT-3.5 Turbo」についてファインチューニング機能を公開し、これらのデータを活用してカスタマイズを行うことができるようになっています。

これにより、ユーザーや企業が指定した言葉で受け答えができるようになり、例えば日本語でのやり取りオンリーで答えていくことも可能になっています。こうして、ハイスペックのモデルを活用して自分たちが使いやすい形で開発できるようになっているのがファインチューニングです。

大規模言語モデルが進化すれば、その分、企業が提供しているチャットボットなどの性能も高まっていくことでしょう。ファインチューニングによって利便性がますます向上していくことは間違いなく、生成AIのファインチューニングの支援などの動きも目立ち始めています。

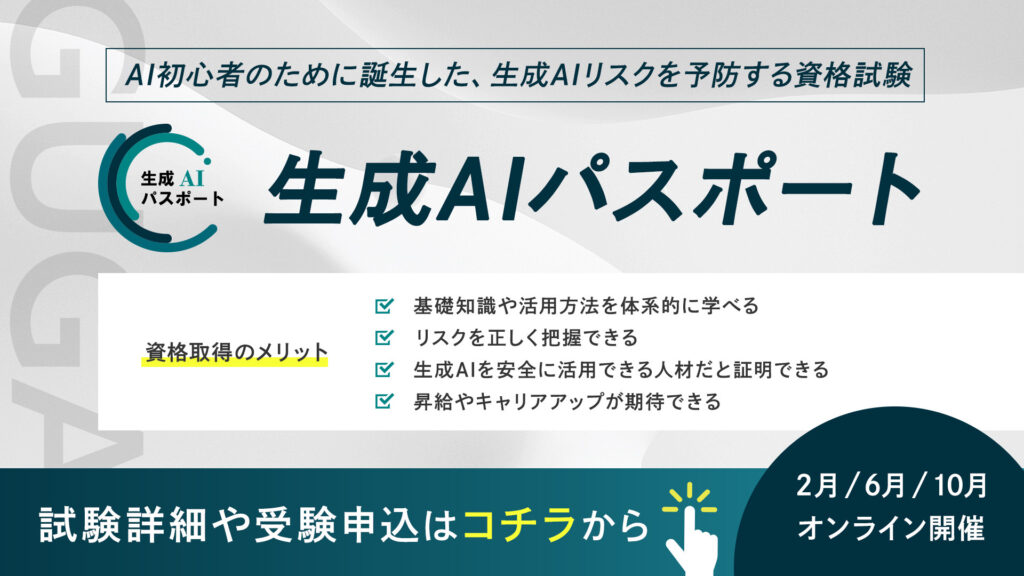

さらに、今注目を集める生成AIリスキリングの第一歩を。生成AIパスポートとは?

生成AIパスポートは、一般社団法人生成AI活用普及協会(GUGA)が提供する、AI初心者のために誕生した、生成AIリスクを予防する資格試験です。AIを活用したコンテンツ生成の具体的な方法や事例に加え、企業のコンプライアンスに関わる個人情報保護、著作権侵害、商用利用可否といった注意点などを学ぶことができます。

⽣成AIの台頭により、AIはエンジニアやデータサイエンティストといった技術職の方々だけではなく誰もがAIを使えるようになりました。今、私たちがインターネットを当たり前に活用していることと同様に、誰もが生成AIを当たり前に活用する未来が訪れるでしょう。

そのような社会では、採用や取引の場面で、生成AIを安全に活用できる企業・人材であることが選ばれる前提条件になり「生成AIレベルの証明」が求められることが予測できます。生成AIパスポート試験に合格すると、合格証書が発行されるため、自身が生成AIを安全に活用するためのリテラシーを有する人材であることを、客観的な評価として可視化することが可能です。

ぜひあなたも生成AIレベルを証明し「生成AI人材」に仲間入りしましょう!