Few shot learningとは何?意味やファインチューニング・転移学習との違いをわかりやすく解説

INDEX

- Few shot learningとは何?

- Few shot learningの意味

- Few shot learningを可能にさせるデータ拡張

- Few shot learningを行うメリット

- データ量と時間の削減につながる

- データが不足しやすい状況に対応できる

- Few shot learningのデメリット

- 過学習の問題

- 汎用性に欠けることも

- Few shot learningとファインチューニング・転移学習との違い

- Few shot learningとファインチューニングの違い

- Few shot learningと転移学習の違い

- Few shot learningの活用が期待されるジャンル

- 大規模言語モデル

- 音声合成技術

- ChatGPTとFew shot learningの関係性

- まとめ

- さらに、今注目を集める生成AIリスキリングの第一歩を。生成AIパスポートとは?

皆さんはFew shot learningをご存じですか?Few shot learningは少ないデータで機械学習を行う際に用いられる手法です。画像解析や自然言語処理で用いられるなど、今後のディープラーニングにおいても注目を集めるやり方です。

本記事ではFew shot learningに着目し、Few shot learningとは何か、ファインチューニングや転移学習との違いなどを解説します。

Few shot learningとは何?

Few shot learningとはどういうものなのか、その意味や基本的な情報を解説していきます。

Few shot learningの意味

Few shot learningはフューショット学習とも呼ばれ、言葉の意味通り、少ない情報で行う機械学習です。少量の学習データを活用していくのが特徴的で、大量のデータを用いる機械学習とは対照的に、Few shot learningの場合は画像であればたった数枚、多くても数十枚程度で事足ります。

Few shot learningを可能にさせるデータ拡張

Few shot learningは少ないデータで事足りるのが特徴で、画像も数枚あれば十分足りると言われています。なぜ数枚の画像で足りるのか、その理由はデータ拡張にあります。データ拡張は画像のデータに加工を加えることで実質的に学習する画像の数を増やしていくという手法です。

画像を回転させたり、左右にずらしてみたりしてデータを増やしていくことで、たった1枚の画像で何パターンもの画像を生み出すことができます。Few shot learningにおいてはデータ拡張なしには成立しないことがわかります。

Few shot learningを行うメリット

ここからはFew shot learningを行うメリットについてご紹介します。

データ量と時間の削減につながる

Few shot learningの場合、必要なデータ量を抑えることができ、時間の削減にもつながります。機械学習を行う場合、1クラスで数千件、場合によっては100万件、1000万件が必要になり、当然ながらデータ量も時間的なコストもかかります。

その点、Few shot learningは数件のデータだけで事足ります。もちろん、学習済みモデルを作る必要がありますが、それでもわざわざゼロから作り上げていく必要はないので、時間的なコストはかなり削減できるでしょう。様々な面でコストをかけなくて済むのはFew shot learningの魅力です。

データが不足しやすい状況に対応できる

Few shot learningが本領を発揮するのはデータがなかなか集まらず不足しやすい状況にも対応できる点です。画像認識の場合でも例えば、医療系のように難病に関するデータとなるとなかなか集めるのは大変で、あったとしてもほんのわずかということがあります。

Few shot learningであれば、わずかなデータしかなかったとしてもしっかりと対応することができます。学習済みモデルを駆使し、そのモデルから得た知識を活用しながらFew shot learningを行っていきます。そのため、サンプル数が少なくてもしっかりと対応することが可能なのです。

少ない画像数でも、データ拡張がポイントになります。極端な話、左を向いている猫だけで学習をしていると右を向いている猫を猫として扱ってくれない可能性があるので、色々な方向を向く猫で学習していきます。これにより、猫を猫として捉えてもらうことができるようになるのです。

Few shot learningのデメリット

次にご紹介するのはFew shot learningに関するデメリットです。

過学習の問題

少ないデータ量で学習が行えることはFew shot learningのメリットですが、一方で少ないデータ量ゆえの問題があります。それが過学習です。データが少ないとその中で集中してしまうため、柔軟性に欠けるケースが出てきます。

少ないデータに偏ってしまう分、その後新しいデータを追加しても対応しにくくなってしまうのが大きな問題です。Few shot learningでも一定レベルの質を確保しなくてはならないので、過学習でそれができなくなるのは大きな問題と言えるでしょう。

データ拡張をもってしても過学習を解消できない可能性があります。結局向きを変えたり、色を変えたりしても、基本的には似たような画像なので、その画像に関連したものでしか反応しなくなる可能性があります。ですので、データ拡張を過度に頼り過ぎるのもいいとは言えません。

汎用性に欠けることも

Few shot learningによって、特定の条件に関してはうまく対応できる一方、別の条件に対してはうまく機能しなくなることがあります。いわゆる汎用性に欠けているような状態です。

例えば、Few shot learningによって猫の画像を仕分けするAIを作ったとします。Few shot learningで猫に特化して開発した分、猫以外の画像を使って仕分けをしようにもできなくなってしまう状態が起こり得ると言えるでしょう。

Few shot learningとファインチューニング・転移学習との違い

ここからはFew shot learningとファインチューニング・転移学習との違いについてご紹介していきます。

Few shot learningとファインチューニングの違い

ファインチューニングは事前学習をしたものに新しい層を追加する形で再学習を行っていくやり方です。あらかじめ事前学習を行ってから、新しいタスクに対応していくために追加の学習データで再学習を行う流れです。

Few shot learningは最初から少ないデータで対応でき、小さなデータセットがあれば問題ないですが、ファインチューニングは一定の大きさのデータセットで訓練を重ねてから行う必要があるため、その点に違いがみられます。

Few shot learningと転移学習の違い

転移学習はどちらかといえばファインチューニングと似ており、大きなデータセットで訓練を重ねたモデルを活用していきます。大前提となるのが大規模なデータセットの存在であり、これなしには成立しません。

Few shot learningと転移学習の違いは少ないデータから新たな知識を得ていくのがFew shot learning、元々あった知識を新たなタスクに活用して再利用を目指していくのが転移学習という違いです。

Few shot learningの活用が期待されるジャンル

ここからはFew shot learningの活用が期待されるジャンルについてご紹介していきます。

大規模言語モデル

大規模言語モデルにおいてFew shot learningは欠かせない存在となります。Few shot learningを行う際にはプロンプトにおいていくつか例を出して、法則にしたがうような形でタスクをこなしてもらいます。

1つ1つ例を示すことで大規模言語モデルがしっかりと動くようになります。むしろそれをしないとなかなか動かないのが実情です。ChatGPTを始め、大規模言語モデルを活用していく際にはFew shot learningを活用しながら動かしていくことになります。

音声合成技術

Few shot learningは音声合成技術でも活用されています。少しの対話データがあれば、その人の口調を始め、特徴をつかみ、それを踏まえて対話を行っていきます。声色なども調整できるため、少ししかデータがない中でも音声の合成ができるようになります。

今まではたくさんのデータがないとできませんでしたが、Few shot learningで実現可能となりました。音声合成技術を活用すればそれを活用することで、その人になりすますこともできるようになると言えます。

ChatGPTとFew shot learningの関係性

多くの人が知っているAIにChatGPTがありますが、実はChatGPTとFew shot learningには密接な関係性があります。ChatGPTを作ったOpenAIは2020年に論文を発表し、当時話題を呼びました。

それまでGoogleが開発した言語モデルはファインチューニングによって新しいタスクに対応する形でしたが、ChatGPTは少しの教師データがあれば活用できたのです。これこそがFew shot learningです。Few shot learningの歴史は非常に浅く、ここ数年の技術と言えます。

大規模言語モデルでFew shot learningを使う場合やOne-shot learning、Zero-shot learningとそれぞれ使った場合に数を大きくすればそれだけ性能が良くなります。この中だとFew shot learningが多くなります。ちなみにFew shot learningでは数十もしくは100が1つの目安になりやすいです。

まとめ

Few shot learningは今後のAI開発にとってなくてはならない技術です。一方で、注意すべき点も多く、過学習の問題などに注意しなければなりません。ここ最近登場した技術なので改善しなければいけない点もありますが、上手く活用できればコスト的にも大きな負担をかけずに開発に取り組めるでしょう。

ChatGPTなど、Few shot learningとの関係性が深いものもある中で、更なる進化を遂げるためにもFew shot learningの技術がより磨かれていくことに注目することをおすすめします。

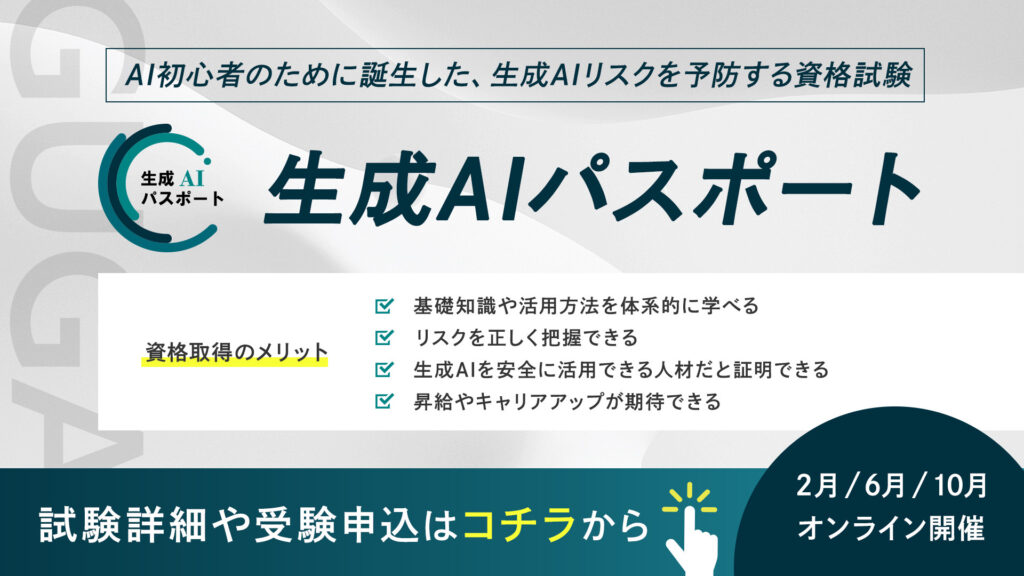

さらに、今注目を集める生成AIリスキリングの第一歩を。生成AIパスポートとは?

生成AIパスポートは、一般社団法人生成AI活用普及協会(GUGA)が提供する、AI初心者のために誕生した、生成AIリスクを予防する資格試験です。AIを活用したコンテンツ生成の具体的な方法や事例に加え、企業のコンプライアンスに関わる個人情報保護、著作権侵害、商用利用可否といった注意点などを学ぶことができます。

⽣成AIの台頭により、AIはエンジニアやデータサイエンティストといった技術職の方々だけではなく誰もがAIを使えるようになりました。今、私たちがインターネットを当たり前に活用していることと同様に、誰もが生成AIを当たり前に活用する未来が訪れるでしょう。

そのような社会では、採用や取引の場面で、生成AIを安全に活用できる企業・人材であることが選ばれる前提条件になり「生成AIレベルの証明」が求められることが予測できます。生成AIパスポート試験に合格すると、合格証書が発行されるため、自身が生成AIを安全に活用するためのリテラシーを有する人材であることを、客観的な評価として可視化することが可能です。

ぜひあなたも生成AIレベルを証明し「生成AI人材」に仲間入りしましょう!