AIにはどのような問題点がある?AIが抱えるデメリットやその解決策と事例をわかりやすく解説!

INDEX

- AIに問題点があるとはどういうことか?

- AIにおけるプライバシーや個人情報の問題

- プライバシーや個人情報の問題にかかわるAI技術

- AIの長所が弱点を生み出している

- 内部はブラックボックス化している

- 著作権侵害の問題

- AIの著作物は著作権で守られない

- 逆に著作権侵害になることもある

- 誤情報の取得と情報の安全性

- データに偽情報が含まれる or 含まれなくても偽情報を出力する

- 偏見や差別を反映する

- 法整備の問題

- 雇用(失業)の問題

- 雇用に関係する事例

- 大失業の社会問題はいま焦る必要がない理由

- 自分で考える力が失われる可能性があるAI依存

- 教育機関でもAIを活用するため影響が大きい

- AI以外で現代の技術が人の健康にとって悪い要因となった事例

- シンギュラリティ問題

- まとめ

- 生成AIパスポートとは?

AIは急速に社会に広まって、多くの人が利用するに至っています。

しかし、AIにあまり詳しくない人は、AIを使うことでどのような問題点があるのか、知らないケースも少なくありません。

そこで、AIの問題について7つをピックアップして詳しく解説します。

この記事を読めば、AIの問題点と個人・企業がリスク回避に必要なことがわかるでしょう。

AIに問題点があるとはどういうことか?

AIは、社会においてさまざまな分野で導入されています。しかし、企業や行政、個人により使われるAIには、大きく分けて3つの問題点を確認することが可能です。

(1)AIを使うことにより個人に起きる問題

(2)企業・行政がAIを使用することで起こりうる問題

(3)社会全体で起こる問題点

個人レベルで起こる問題は、プライバシーや個人情報、著作権侵害、誤情報の取得などです。

企業や行政では、プライバシーや個人情報に加えて、責任の所在、セキュリティや情報の安全に関わる面が挙げられます。

社会全体では、法整備や雇用(労働者の失業)、教育の問題、シンギュラリティ問題などが代表的です。

AIにおけるプライバシーや個人情報の問題

個人や企業、行政にとってAIの問題は、身近なものになりつつあります。その理由は、プライバシーや個人情報の問題が取り上げられるようになったからです。

プライバシーや個人情報の問題にかかわるAI技術

AIの技術的革新の契機となったのは、画像認識技術(2012年からAIに再注目されたディープランニング)です。

他にも、音声認識技術、テキスト生成技術(会話応答性能)の発展は、プライバシーや個人情報の問題に大きく関わっています。

理由は、AIが「ないもの」から「あるもの」を生み出すわけではなく、もとは人間が生み出した情報をAIが再現し、再合成しているからこそ起こり得る問題だからです。

AIの長所が弱点を生み出している

AIの強みは、個人や企業のデータを収集し、分析することで人間の能力を再現、予測、シミュレーションできることにあります。

しかし、取得した情報の中にプライバシーや個人情報を含む場合、ビッグデータから情報の漏洩や悪意を持った開発者・ハッカーによる悪用が可能となってしまうのです。

また、本来はAIが個人情報を取得する場合に、その目的や手段を明らかにし、利用者の許可が本来は必要でしょう。

しかし、まだ細かい規定がなく、AIが無差別にデータを取得することがあります。

ネット上に上がっている個人情報はたくさんあり、AIが学習した場合に、無断で個人情報を取得されるのです。

無断でなくても、企業が個人情報を含むデータを集めてAIに学習させた場合も同様といえます。

内部はブラックボックス化している

AIは開発者を除いてシステム内部の細かい調整はブラックボックスになっています。

しかも、内部でどのように個人のデータが使われているか、AIの複雑性により正確には開発者ですらわかりません。

この点も個人情報がどのように使われるか不測の事態を把握しきれない原因になっています。

以上の原因をすぐ解消することはできません。ですが、個人情報の取り扱いを決めて、AI活用の方針を会社や国で決めましょう。

そのルール内で運用すれば最低限問題を解決することができます。

著作権侵害の問題

AIの中でも問題となることの1つがAI生成物の著作権侵害についてです。

AIの著作物は著作権で守られない

まず、日本では、AI生成物は通常の著作物のような著作権対象の範囲には入りません。

通常の著作物が人間によって創作されるのに対し、AI生成物はAIが機械で自動的に作り出したものだからです。

法律でも明確に決まっているわけではありませんが、2023年現在は、著作物性が認められたケースはありません。

逆に著作権侵害になることもある

AI生成物が既存の著作権物を含む利用の場合は、そのまま利用することで著作権の侵害に該当するケースもあるほどです。

AIが生成した文章を気づかずにコピペ添付して利用した側が、訴えられることもあるかもしれません。

また、完全一致しなくてもイラストや写真は特徴が一部似ることがありますし、文章も調子や論調が一致することもあります。

そのため、画像生成AIやテキスト生成AIは、すでに世間でAIのデータ収集の仕方に制限を加えるべきだという声を上げる人や集団が出てきています。

特に、イラスト作者やイラスト・写真のサイト運営者、新聞社などです。

ただし、AI生成物の著作権侵害については、世界的にもまだはっきりした結論が出ていません。

その上で、AI生成物の著作権侵害に関する問題は、法律や技術の両面からの対策が求められています。

いまのところは、AI技術の発展とともに著作権法や知的財産法も議論し、適切に運用されるように改正や見直しをすることが解決の糸口となるでしょう。

誤情報の取得と情報の安全性

AIには、2つの意味で誤情報の取得と情報の安全性が問われることがあります。1つは、最初から、間違った情報を出力するケースがあることです。

もう1つは、意図的にフェイク(偽)画像や動画の作成・公開等が挙げられます。

具体例としては、首相の偽動画や芸能人や有名人の写真や動画を悪用したなりすましやイメージを落とすような内容を含めた名誉毀損のコンテンツです。

AIで悪い意味のニュースとしてよく取り上げられます。

データに偽情報が含まれる or 含まれなくても偽情報を出力する

まず、AIは大量の学習データをもとに情報を生成します。

しかし、その学習データに偽情報が含まれている場合、AIが間違った情報を出力することが問題です。

偽情報を取得していなくても、質問内容によっては、間違った情報を出力することもあります。

例えば、ChatGTPは本来計算機として使うものではありませんが、文脈の中で計算させた場合に、簡単な足し算や算数、数学などはプレーンテキストで打ち込んだときに、答えを間違えることも珍しくありません。

また、別の情報と混同して間違った回答を「確実な情報」であるかのような返答内容で出力することもあります。

その結果、誤った情報が広まり、人々が混乱や間違った常識を持つことになるでしょう。

解決策として、間違った情報を出力する背景に、AIが細かい差分への対応が難しく、具体的な指示を受け付けにくい(正確な答えを出しにくい)ことを理解する必要があるのです。これを知っているだけで、間違った出力情報に振り回されにくくなります。

偏見や差別を反映する

AIは学習データに含まれる偏見や差別を回答結果に反映することがあります。

プロファイリングの固定観念や差別思想が反映されてしまう現状はよく知られているでしょう。

原理的には、学習データが特定の人種や性別に偏っている場合、AIがそれを学習し、情報生成においてもその偏見という暗黙の価値観を反映することが背景にあるのです。

特に国内では肌色に対してそこまで反応が敏感ではありませんが、欧州やアメリカでAIを活用して会話したり、議論したり、公的なアナウンスをする場合は、特に気をつける必要があります。

以上の問題は、AIの倫理的なガイドラインや規制の整備も不可欠です。

解決には、AIの信頼性に影響されすぎず、ファクトチェックを十分に行うなどします。冷静な態度で倫理的・抑制的な視点から取り組むことが重要でしょう。

法整備の問題

AIの法整備に関する問題は、AIの活用が急速に拡大する中で対応が急務となっています。

実際に、著作権の問題やプライバシー・個人情報の問題は、法整備や対応が後手に回っているでしょう。

そして、法整備の問題は、近年注目を集めているのです。

特に倫理的な問題やリスクが浮き彫りになり、それに対する規制や法整備の必要性が議論されています。特に日本では、AI規制について慎重な姿勢も影響しているのです。

AIの活用による個人情報のプライバシー侵害や、人種差別や性差別などの問題を防ぐためにも、適切な規制や法整備がAIに対して求められています。

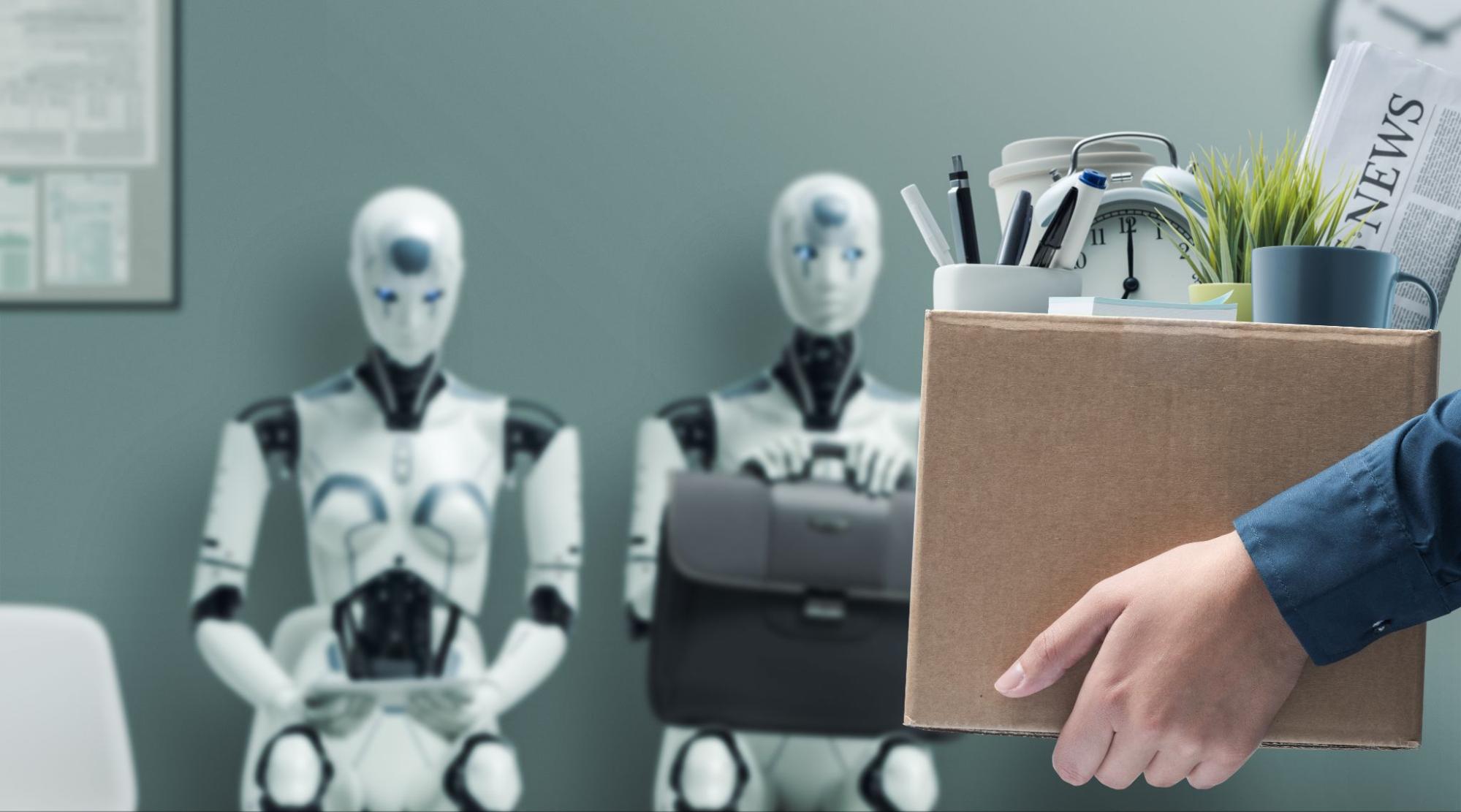

雇用(失業)の問題

AIの進歩に伴い、失業問題が浮上しています。この問題は、AIが人間の仕事を奪うことによって引き起こされるものです。

特に反復業務や予め決められた定型的な業務は、AIによって代替されることが想定されています。

雇用に関係する事例

決まった質問に対してある程度、内容を絞った返答ができるチャットボットは、カスタマーサービスでも活用されています。

そのため、カスタマーサービスに関連したコールセンターの設置やその人員が少なくて済むなど、すでに人材削減を目的に導入が始まっているのです。

2023年の現在は、AIにすべてを任せられる段階ではないため、一部の代替や補助的な役割に収まっています。

しかし、その影響を受けて技術系のエンジニア業界やEC系の物流業界、WEB系のサービス業界などは、上記のように、すでに人員を減らす採用や雇用などが実態として進んでいるのです。

例えば、倉庫管理では複数の倉庫の在庫管理を手打ちでエクセルなどに入力して管理し、在庫の予測をしていたものが、近年になって自動化し、AIにより予測の精度が高まったことがあります。

専門の人材を雇わなくても運用を効率化することが可能です。

これはAIの費用的な削減メリットでもありますが、雇用(失業)視点から問題を見たときは、社会全体の問題となります。

大失業の社会問題はいま焦る必要がない理由

現状で不安視されているような大規模な失業問題が直ちに起こるわけではありません。

なぜなら、AIは過去にパソコンのことをそう呼んでいて、社会に導入された時、多くの失業者を出すといわれましたが、実際には起きなかったためです。

それは電子メールの導入で「郵便が廃れる」、「配達員の仕事が奪われる」といわれた時代のことでもあります。

しかし、実際には郵便は廃れておらず、手書きの文章もペーパレス化もすぐには進まず、紙や印刷機の需要もなくなっていません。

IT化で需要の下火になることは起こっていますが、雇用(失業)問題に大きくつながるものではないでしょう。

つまり、雇用(失業)の問題の規模を判断するときは、一概にAIの雇用に対する影響を意識しすぎないことも重要です。

AIにはできることとできないこと、得意なことと苦手なことがあります。そのため、どこかで必ず人手が必要になるのです。

できるところは効率化し、人手が必要なところは残ると考えましょう。

自分で考える力が失われる可能性があるAI依存

AIはさまざまなことを人の変わりに行うことができるため、とても便利です。

しかし、人間が思考して手段や方法を考えるのとは違い、簡単なお願い(命令)で答えを出してしまうともいえます。

特に、問いかけてそれで答えが出る応答型AIや行動まで実際に行うロボティクス系AIの多くは、AI依存を引き起こすのです。

わからないときだけ少し利用するという程度であれば影響ありませんが、頻繁に利用する、ほとんど任せてしまうという「AIが当たり前な社会」では、考える機会そのものが失われていきます。

教育機関でもAIを活用するため影響が大きい

教育にもAIを使うのが当たり前になるため、当然ながら教育機関での学習もあえて思考する機会を除いてAIが多くなります。

AIの脅威説は、実際に起こったことがないために「問題を意識できない」ことが珍しくありません。

しかし、考える機会が失われてそれが影響するケースは、すでに現代のIT化や機械化ですぐに起こっていることです。

AI以外で現代の技術が人の健康にとって悪い要因となった事例

車は現代の乗り物として知られていますが、人が歩いて移動する機会を奪った事例です。

若年・中年層の運動不足を引き起こし、生活習慣病の要因を強めたり、高齢者の足腰の弱さにつながったりしています。

また、スマホの普及により、本で調べ物をする機会が減り、本を読む機会そのものが失われているのです。

出版社は、少子化の影響もありますが、近年の売上低下など出版物が売れない状況を危惧しているのにもあらわれています。

AIは、それ自体が考える力を失わせるわけではありません。しかし、社会に浸透して当たり前のものとして使われだしたとき、人々に大きな代償を支払わせることになります。つまり、思考力低下という社会問題です。

AIに使われるのではなく、自分で使うというスタンスを明確にしましょう。最小限の利用で最大の効率を上げることが問題への解決策です。

シンギュラリティ問題

シンギュラリティ問題は、AIが人間の知能を超える技術的特異点を指す概念です。

AIの進化が指数関数的に進み、2045年問題として人間の知能を超越するというものといえます。しかし、現時点で心配する必要はありません。

なぜなら、シンギュラリティは確実なものではなく、人間の脳内を再現するには、ブラックボックスが多すぎるためです。

実現のためには、脳内の解明が科学的・医学的にもう少し進んで、AIの設計を根本からもう一度変える必要があります。

知識の蓄積や技術の蓄積だけでは、今の人間の知能(を代表する感情や思考能力)を上回ることはできません。

それから、20年以上先のことはもはや未来予知と変わらないため、いま重視すべきAI問題としてはそこまで優先度が高くないでしょう。

解決策を得るには今後の議論が必要です。

まとめ

今回は、AIの問題について、3つの分類から判明している問題点を7つ取り上げました。

AIは人が上手く活用することでさまざまな効率化や利便性の向上が見込めます。しかし、それに付随して、問題を引き起こすこともあるのです。

特に、AIが急速に発展して社会がその制度づくりや法律、倫理などに対応しきれない期間は、さまざまな問題が社会に表出しやすくなります。

そこで、AIにどのような問題があるかを知り、課題解決を社会の一員として一緒に模索してみましょう。

企業の方なら、事前にAI利用をする上で知っておけば、管理するときの問題把握やリスクの回避ポイントを押さえておくことができます。

生成AIパスポートとは?

生成AIパスポートはエンジニア職だけでなく一般の方向けの資格です。

生成AI業界における最前線を走っている有識者たちに監修された資格試験で、最先端の確実な知識や簡易的な活用スキルを身につけることができる認定試験・資格です。

試験を通じて、文章生成をすることができるChatGPTなど、AIを活用したコンテンツ生成の具体的な方法や事例に加え、企業のコンプライアンスに関わる個人情報保護、著作権侵害、商用利用可否といった注意点などを学ぶことができます。

生成AIの活用普及を目的とした、国内最大級の生成AI団体である、一般社団法人生成AI活用普及協会(GUGA)が発行する認定試験です。