マルチタスク学習とは?基本〜実装の流れと転移学習との違いをわかりやすく徹底解説!

INDEX

- マルチタスク学習とは

- 複数のタスクを1つのモデルで行うやり方

- マルチタスク学習と転移学習との違い

- マルチタスク学習が利用される分野

- 画像認識分野

- 自然言語処理分野

- 強化学習

- マルチタスク学習を実装する流れ

- マルチタスク学習で取り入れるタスクを選ぶ

- タスクに対応するデータセットを選ぶ

- マルチタスク学習の中心となるアーキテクチャを設計する

- 損失関数の定義づけを行う

- モデルの学習を行って評価し微調整を重ねる

- マルチタスク学習を行うメリット

- 効率を高める

- 幅広く対応できる

- マルチタスク学習を行う際のデメリット

- タスク同士で競い合ってしまう

- データのバランス調整

- マルチタスク学習の活用事例

- まとめ

- さらに、今注目を集める生成AIリスキリングの第一歩を。生成AIパスポートとは?

皆さんはマルチタスク学習をご存じですか?マルチタスク学習は機械学習のほか、ディープラーニングにも関係する分野であり、それぞれの作業をより効率的に行うことができます。

本記事ではマルチタスク学習とは何かにスポットを当て、マルチタスク学習が利用される分野や実装する流れについてご紹介します。

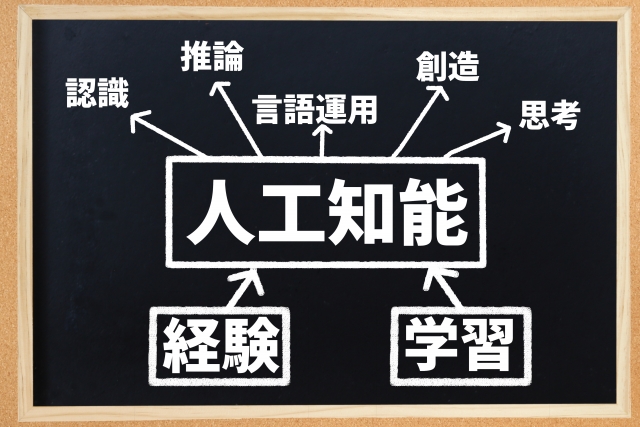

マルチタスク学習とは

マルチタスク学習とはどのようなやり方なのか、基本的な情報について解説していきます。

複数のタスクを1つのモデルで行うやり方

マルチタスク学習はその名の通り、複数のタスクを1つのモデルとして学習を重ねていくやり方です。例えば1つのタスクを1つのモデルで学習していく場合、学習データを必要以上に学習していき、過学習に陥る可能性が考えられます。

過学習を防ぐため、あえてマルチタスクで学習させていくことで過学習を抑えられるほか、せっかくの情報を逃すようなケースを避けられます。

マルチタスク学習と転移学習との違い

マルチタスク学習と似たようなものに転移学習があります。転移学習は別々の課題の中で得られた知識や特徴を再び利用するやり方で、お互いが持つ情報をそれぞれで活用する形でお互いの学習をよりレベルの高い状態で行えるというものです。

一見すると同じようなやり方に見えますが、既に学習済みのものを利用するのが転移学習に対し、マルチタスク学習は同時に学習を行い、共通する内容を活用するという点で異なります。マルチタスク学習の方がより効率的に行える点で転移学習とは異なると言えるでしょう。

マルチタスク学習が利用される分野

ここからはマルチタスク学習が利用されやすい分野について解説していきます。

画像認識分野

画像認識分野では、物体の検出やクラス分類などの課題を同時にこなし、学習を進めていきます。1つの画像があった場合にマルチタスク学習を行えれば、同時にタスクをこなせられるため、効率のいい学習につながるでしょう。

1つのモデルを使い、一方では顔そのものを認識する、もう片方では顔の表情を認識するという具合にマルチタスクで作業を進められます。それぞれが認識し学習を重ねていくことで結果的に画像認識の正確さを高められるため、マルチタスク学習との相性は抜群です。

自然言語処理分野

自然言語処理分野もマルチタスク学習との相性はいいです。自然言語処理分野は翻訳や文章の要約などのタスクを行い、いくつかのタスクを同時に行う中で性能を高めていくことができます。

最初に文章のデータをたくさんを使って学習を重ね、複数のタスクをこなす中でレベルを上げていきます。それぞれの学習を行い、それぞれで得た学習結果を共有して微調整を重ね、性能の向上に努められるため、自然言語処理分野ではマルチタスク学習がおすすめとされています。

強化学習

強化学習に関してもマルチタスク学習との相性はいいとされています。強化学習においてマルチタスク学習を取り入れる主な理由は、マルチタスクを行う能力を高めるためで、マルチタスクを通じて得た新しい知識はそれぞれで共有され、新しい動きにつながっていきます。

強化学習では少しでもいい点数を狙うことが目標であり、手段は問いません。だからこそ、マルチタスク学習を通じて得た新しい動きなどを評価しやすく、普通に学習するよりも速いスピードで様々なスキルを得て効率のいい学習につなげられるのです。

マルチタスク学習を実装する流れ

ここからはマルチタスク学習を実装する流れについてご紹介していきます。

マルチタスク学習で取り入れるタスクを選ぶ

マルチタスク学習を行う際に、まずマルチタスク学習で取り入れるタスクを選択していきます。何と何をマルチタスク学習で学ばせるかを選択しますが、目標としては同じものを使って異なる情報を取り出せることが目指すべき部分です。

同じデータを用いつつ、別々の情報が取り出せれば、その情報を今後活用していくことができます。関連したものであれば相乗効果を得られやすく、効率的な学習につなげられるでしょう。

タスクに対応するデータセットを選ぶ

マルチタスク学習を行う際には、選択したタスクにマッチしたデータセットを選択しなければなりません。この時、既に公開されているものもあれば、自分たちで準備して利用するケースもあります。

データを使う際には前処理を始め、正確な指定などの調整も必要です。特に画像データであれば色彩の確認やサイズの調整といったことも必要です。あとはデータ量の調整を行うことでバランスをとれるようにしていくことも求められます。

マルチタスク学習の中心となるアーキテクチャを設計する

マルチタスク学習を行うことで、アーキテクチャの設計が重要な意味を持ちます。マルチタスク学習を行うアーキテクチャでは共有すべき特徴表現を持ちつつ、それぞれのタスクに関しては独立させて学習させていく形をとっています。

アーキテクチャに関してはどんなタスクを用いるかで変化するため、選択したタスクで設計の中身が変わるような形です。

損失関数の定義づけを行う

機械学習によって出された予測値、実際に出された数値には誤差が生じます。この誤差を計算するのが損失関数です。その損失関数をできるだけ小さくする学習を行わせて、機械学習の段階でより正しい予測が行えるようにしていきます。

モデルの学習を行って評価し微調整を重ねる

損失関数を小さくするようにモデルの学習を行って完了させたら、いよいよその中身を評価する段階に入ります。様々なデータにどのような反応を示すのかをチェックし、評価します。

この評価を踏まえて微調整を行っていきます。この微調整は「ファインチューニング」と呼ばれており、タスクの結果の改善につなげていきます。

マルチタスク学習を行うメリット

ここからはマルチタスク学習のメリットについてご紹介します。

効率を高める

マルチタスク学習を行う最大のメリットは効率です。マルチタスク学習を行うことでそれぞれのタスクからもたらされる情報があり、その情報を共有しながら活用していくことで効率よくモデルの強化につなげられます。

効率を高めることは、学習に用いるデータがさほど多くない時でもそれぞれのタスクで補い合うため、結果的に効率よくモデルの強化につながるのも特徴的です。

幅広く対応できる

マルチタスク学習を行う中で、1つのタスクでは対応できないところまで対応できるようになるのが特徴的です。いわば守備範囲が広がりやすくなり、守備範囲が広がればよりその範囲が広がるという、プラスのスパイラルに入りやすくなります。

守備範囲が広くなることはそれだけ汎用性が高くなることを意味しており、どんなデータにも対応できるような頼もしさがつきます。

マルチタスク学習を行う際のデメリット

一方、マルチタスク学習にはいくつかのデメリットもあるのでご紹介します。

タスク同士で競い合ってしまう

同時にタスクを動かして学習させることで、競い合ってしまうケースが生じます。どちらか一方が品質を高め、どちらかが品質を損ねるような形になりやすく、ただ単に動かすだけでは不十分です。

この場合は同じような扱いにするのではなく、どちらかを上に置くなど、適切な形で評価を行っていき、最終的にバランスの調整を行います。

データのバランス調整

マルチタスク学習を行う際に、複数のタスクを動かす中で片方のデータは豊富にあり、もう片方はあまりデータがないということがあります。この場合、相乗効果があるような結果が出にくくなってしまうため、データのバランスを調整する必要が出てくるでしょう。

データを増やす作業のほか、損失関数の定義づけを今一度考えなおすなど、あの手この手を使って調整を行っていきます。

マルチタスク学習の活用事例

マルチタスク学習は汎用性の高さが出やすくなるのが特徴的ですが、そのメリットを発揮したのがAlphaGoです。AlphaGoは囲碁のソフトであり、囲碁の世界におけるトップ棋士に勝利したことで一躍話題となりました。

実はAlphaGoは囲碁に限らず、将棋やチェスでも同じモデルで学習を行っていく中で結果を残しています。AlphaZeroと呼ばれ、マルチタスク学習を通じて成長を重ねていき、汎用性を高めることに成功しました。囲碁や将棋、チェスはルールこそ違いますが、共通している部分も多くあり、特徴もあります。データセットも少ない中で訓練され、結果を残した点も注目を集めた要素です。

AlphaZeroなどを開発したDeepMindではマルチタスク学習に近い「マルチモーダル深層学習」を導入し、1つのモデルで実に604個のタスクをこなすものを発表しています。マルチタスク学習といってもそのタスク数が数百個以上になるものが一般的になってきた場合に、その進化がえげつないものになる可能性があります。

まとめ

マルチタスク学習は効率よく開発を行っていくのに欠かせない学習手法になることは明らかです。モデル数が少なくて済むほか、それぞれのタスクの相乗効果が生まれやすく、学習時間も減らせるなど魅力は十分です。

マルチタスク学習におけるタスクの数も600個を超えるものが出てくるなど、いかにタスクをこなせるかも今後のポイントになるでしょう。その分、難易度が高くなりますが、結果を出せればよりよいものにつながるのは確かです。

マルチタスク学習は適性のある分野が限られており、その点をどのように評価していくかですが、マルチタスク学習は多くの可能性を秘めており、今後の注目と言えるでしょう。

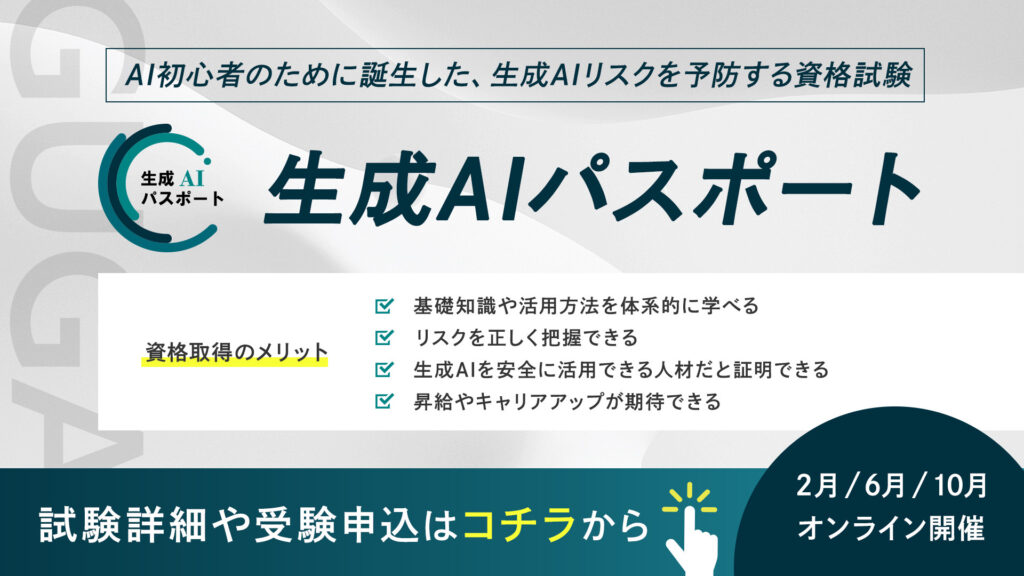

さらに、今注目を集める生成AIリスキリングの第一歩を。生成AIパスポートとは?

生成AIパスポートは、一般社団法人生成AI活用普及協会(GUGA)が提供する、AI初心者のために誕生した、生成AIリスクを予防する資格試験です。AIを活用したコンテンツ生成の具体的な方法や事例に加え、企業のコンプライアンスに関わる個人情報保護、著作権侵害、商用利用可否といった注意点などを学ぶことができます。

⽣成AIの台頭により、AIはエンジニアやデータサイエンティストといった技術職の方々だけではなく誰もがAIを使えるようになりました。今、私たちがインターネットを当たり前に活用していることと同様に、誰もが生成AIを当たり前に活用する未来が訪れるでしょう。

そのような社会では、採用や取引の場面で、生成AIを安全に活用できる企業・人材であることが選ばれる前提条件になり「生成AIレベルの証明」が求められることが予測できます。生成AIパスポート試験に合格すると、合格証書が発行されるため、自身が生成AIを安全に活用するためのリテラシーを有する人材であることを、客観的な評価として可視化することが可能です。

ぜひあなたも生成AIレベルを証明し「生成AI人材」に仲間入りしましょう!